Нейроморфные чипы Что это и почему их называют процессорами будущего

Биологический нейрон по сравнению с современными процессорами имеет ничтожную производительность — всего 10 сигналов в секунду. Но за счет распределенной сети передачи сигнала мозг человека обрабатывает невероятное количество информации одновременно. Современные нейроморфные чипы еще не достигли уровня сложности связей в человеческом мозге, однако вполне могут посоперничать с ним в скорости. Искусственные нейроны, собранные на современных электронных технологиях, могут обрабатывать и пропускать в сотни раз больше сигналов в секунду, чем нейроны человеческого мозга. Нейроморфные чипы потребляют мало энергии, почти не ограничены в возможностях масштабирования — и совершенно не похожи на обычные процессоры. Но что это значит — обычные?

Машины, которые считают

Первые электронные компьютеры появились в годы Второй мировой войны. Они были нужны для расчета баллистических таблиц, дешифровки вражеских сообщений, и поэтому все мировые державы того времени активно спонсировали разработку электронных вычислительных машин (ЭВМ). Главной задачей той эпохи были абсолютная точность и строгое следование заданному алгоритму вычислений.

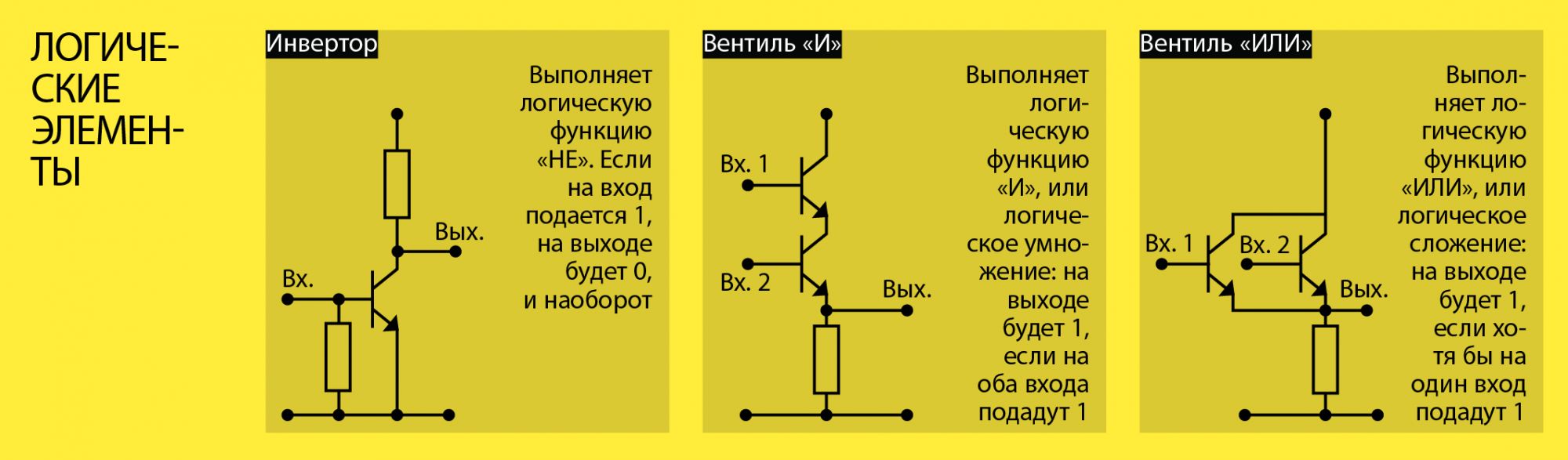

Несмотря на то что современные компьютеры мало похожи на первые ЭВМ, основные принципы остались теми же. Для создания машины, способной к быстрым и точным расчетам, нужны электричество и логический элемент, который управляет протеканием тока от входа к выходу. Это похоже на работу кнопки дверного звонка: когда вы нажимаете на нее, контакты соединяются и звонок звенит; когда вы отпускаете кнопку, контакт размыкается и звук прекращается. В современной технике используются транзисторы, у которых есть контакт для подачи тока на вход, контакт для подачи тока на выход и управляющий контакт, «база», который играет ту же роль, что и палец человека для дверного звонка. В зависимости от того, подают на «базу» ток или нет, транзистор либо пропускает электричество от входа к выходу, либо нет.

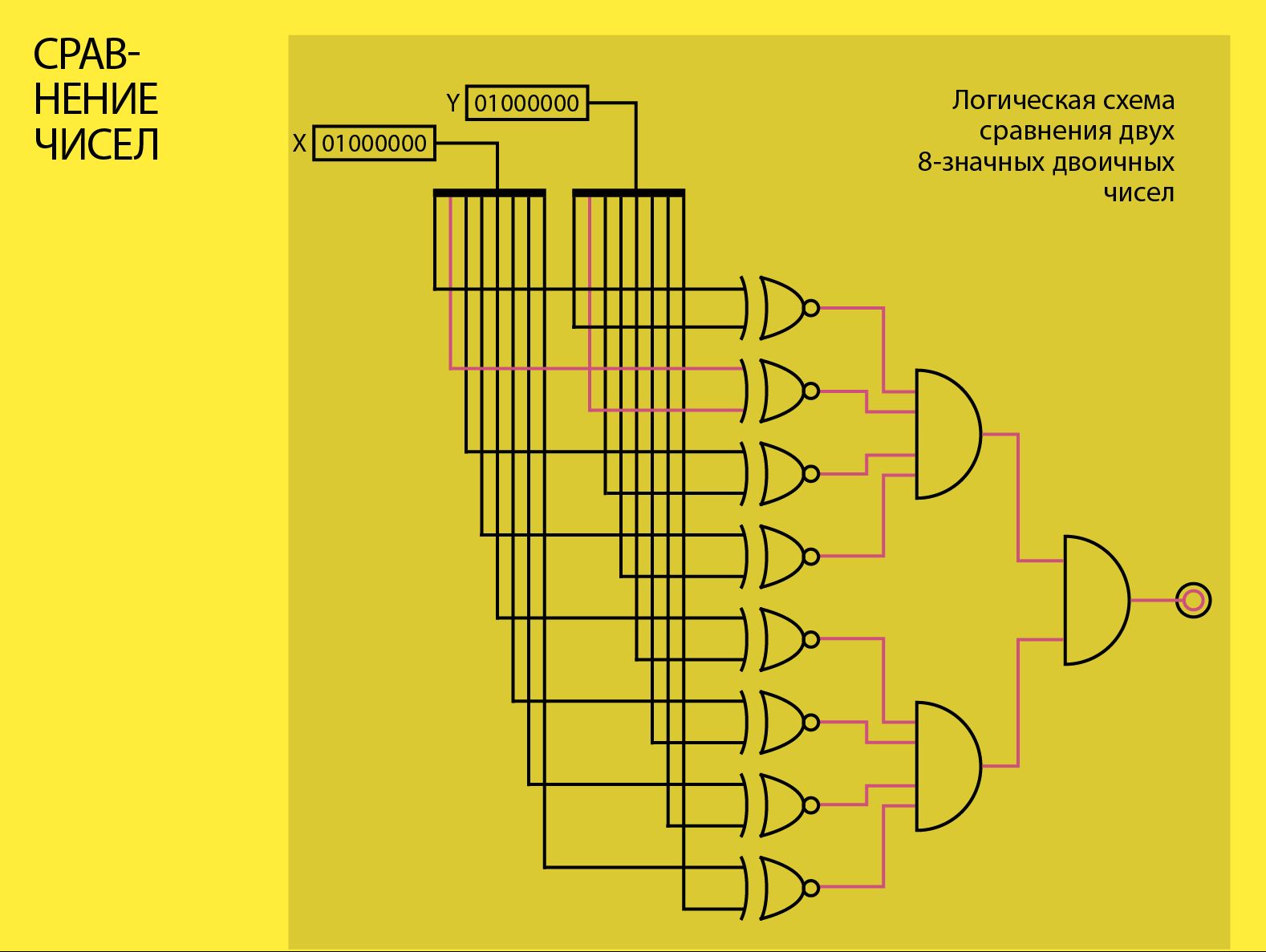

Транзисторы объединяются в базовые логические элементы. Чтобы собрать логический элемент «И», нужно шесть транзисторов. Такой элемент будет пропускать электричество дальше, только если ток подан на оба входящих контакта. Также шесть транзисторов требуется для реализации логического элемента «ИЛИ», а чтобы поменять значение на обратное, достаточно двух транзисторов.

Числа представляются в виде двоичного кода, и наличие тока на контакте означает единицу, а отсутствие — ноль. Чтобы представить число, нужен ряд контактов, каждый из которых отвечает за отдельную цифру. Чтобы произвести над входными числами какую-то операцию, например сложить, умножить или сравнить, нужно из базовых логических элементов собрать логическую схему. Чтобы сделать процессор, необходимо собрать схемы для разных операций в одном месте и в зависимости от того, какая операция производится, использовать ту или иную схему из набора. Эта часть процессора называется арифметико-логическое устройство (АЛУ).

Процессор получает вереницу операций на вход и выполняет их по очереди в строго определенном порядке. Это похоже на работу конвейера: одна «механическая рука» превращает код команды в элементарные операции, другая подает данные на вход, третья применяет поданную операцию к данным, четвертая сохраняет результат в ячейке памяти. Для работы системы нужна безупречная синхронизация, иначе «рука» АЛУ схватит данные от другой операции, сохраняющая «рука» положит результат в неверную ячейку памяти, и весь дальнейший расчет станет неверным.

Узкое место такой системы — тактовость, последовательность работы. Параллельные вычисления на нескольких процессорных ядрах дают свой эффект для некоторых задач, но в большинстве случаев разделение расчетов на независимые потоки и совмещение полученных ответов оказывается неоправданно сложным.

Машины, которые учатся

Человеческий мозг устроен иначе. Он состоит из множества отдельных нервных клеток, нейронов, каждая из которых принимает сигналы от других нейронов, преобразует их к двоичному сигналу и отправляет дальше по сети. Каждый нейрон работает как бинарный индикатор признака: «было» или «не было», и это немного роднит человека с компьютерами. Скажем, нейрон, который распознает ворóн, посылает импульс всякий раз, когда в поле зрения попадает ворона.

У большинства нейронов нет прямого доступа к данным от органов чувств. Вместо этого они подключаются к другим нейронам, которые дают нужные им сигналы, и делают выводы на основе такой обработанной информации. В течение жизни связи между нейронами меняются: какие-то усиливаются, какие-то ослабляются. Некоторые появляются ниоткуда или, наоборот, исчезают. Это свойство — нейропластичность — одна из ключевых особенностей, делающих обучение на опыте возможным.

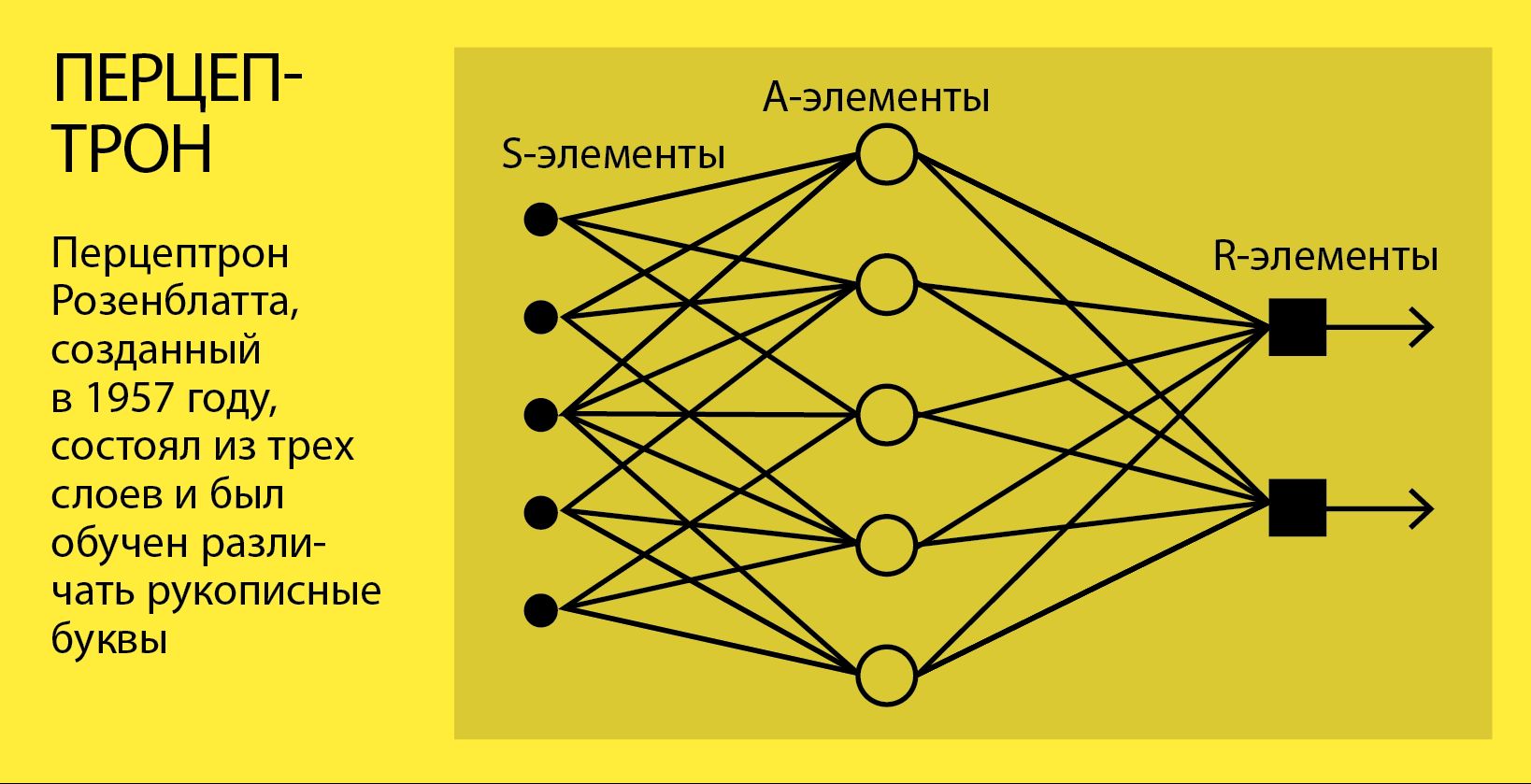

Изучение мозга подтолкнуло ученых к созданию искусственных нейросетей — вычислительных систем, которые, подобно человеку, могут обучаться на основе опыта. Математическая модель нейрона выглядит как сумма всех входящих сигналов с коэффициентами и преобразование, которое либо обнуляет сигнал, либо оставляет его. Нейросети составляются из нескольких слоев нейронов, где каждый следующий слой получает на вход результат работы всех нейронов предыдущего слоя. Это во многом похоже на то, как устроена работа мозга на самом деле.

На вход нейросети подают примеры данных и смотрят, что получилось на выходе. В зависимости от того, насколько ответ нейросети совпал с ожидаемым, корректируют значения коэффициентов (их называют параметрами) — иначе говоря, ослабляют или усиливают связь между отдельными нейронами. Если алгоритм корректировки выбран успешно, то после десятков или сотен тысяч примеров параметры каждого нейрона сами подстраиваются под данные. И мы можем научить нейросеть распознавать рукописные буквы, даже если не можем сформулировать пошаговый алгоритм, по которому можно отличить а от б.

Математическая теория обучения нейросетей была заложена еще в 50–60-е годы прошлого века. Были написаны первые перцептроны — алгоритмы, имитирующие работу нейросети на ЭВМ. Для этого все вычисления, как для самих нейронов, так и для корректировки их параметров, выстраивались в общую очередь и выполнялись на классическом процессоре. Однако процессоры общего назначения оказались одновременно слишком мощными и недостаточно мощными для заметных успехов в этой области: для обсчета нейросети нужны очень простые операции — в основном только сложение и умножение. Однако таких операций нужно производить на порядки больше, чем доступно обычному процессору.

Машины, которые работают

На протяжении всего XX века нейросети оставались в основном теоретической разработкой, уделом математиков и редких инженеров-энтузиастов. Прорывные успехи в этой области случились относительно недавно с выходом на рынок графических процессоров (GPU), способных к гораздо более эффективному вычислению нескольких простых операций. С 2015 года нейросети стали проникать во все сферы жизни. Благодаря мощным GPU и библиотекам для разных языков программирования экспериментировать с ними мог любой желающий. Появились понятливые голосовые помощники, автопилот Tesla, оплата лицом, ChatGPT и Midjourney.

Несмотря на впечатляющие успехи, современные нейросети являются сильно упрощенной моделью работы биологических нейросетей. Они демонстрируют возможность воспроизведения машиной природных концепций, но их возможности на порядки отстают от природного прототипа. Нейроморфные, то есть подобные живым нервным клеткам, чипы — это попытка создать новое поколение машин, где работа нейронов будет представлена не только грубой математической моделью, но будет воспроизводить концепции работы мозга на аппаратном уровне.

Впервые нейрочип был показан широкой аудитории корпорацией Intel в 2014 году. За прошедшее десятилетие появилось множество разных разработок на эту тему от разных компаний. TrueNorth, Neurogrid, BrainScaleS, SpiNNaker, Intel Loihi, Akida, Tianjic, Dynap-SEL, XYLO, отечественный «Алтай» — далеко не полный список существующих на сегодняшний день нейроморфных чипов. Сейчас это тема активных научных разработок, поэтому здесь нет каких-то устоявшихся стандартов, каждая лаборатория пытается воплотить свои идеи в кремнии и железе. Однако большинство из них строится вокруг схожих принципов.

В первую очередь это асинхронность и импульсность — отказ от тактовой частоты и конвейера. Каждый нейрон работает независимо и посылает сигнал, когда его триггер срабатывает. При этом возникает необходимость усложнить логику обработки входных сигналов: вместо одномоментного считывания актуальных данных на входных контактах нейрону нужно уметь интегрировать сигналы, приходящие в разные моменты времени.

Еще одно важное отличие — память. Если в искусственной нейросети модель описывается сотнями миллионов параметров, которые хранятся на диске и подгружаются в процессор при обсчете каждого следующего узла нейросети, то в нейроморфных чипах память — это измененное состояние нейрона. По мере обучения и накопления опыта каждый нейрон постепенно меняет свои параметры обработки сигналов, приоритизируя одни синапсы и отключая другие. Это состояние хранится в памяти самого нейрона.

Машины, которые развиваются

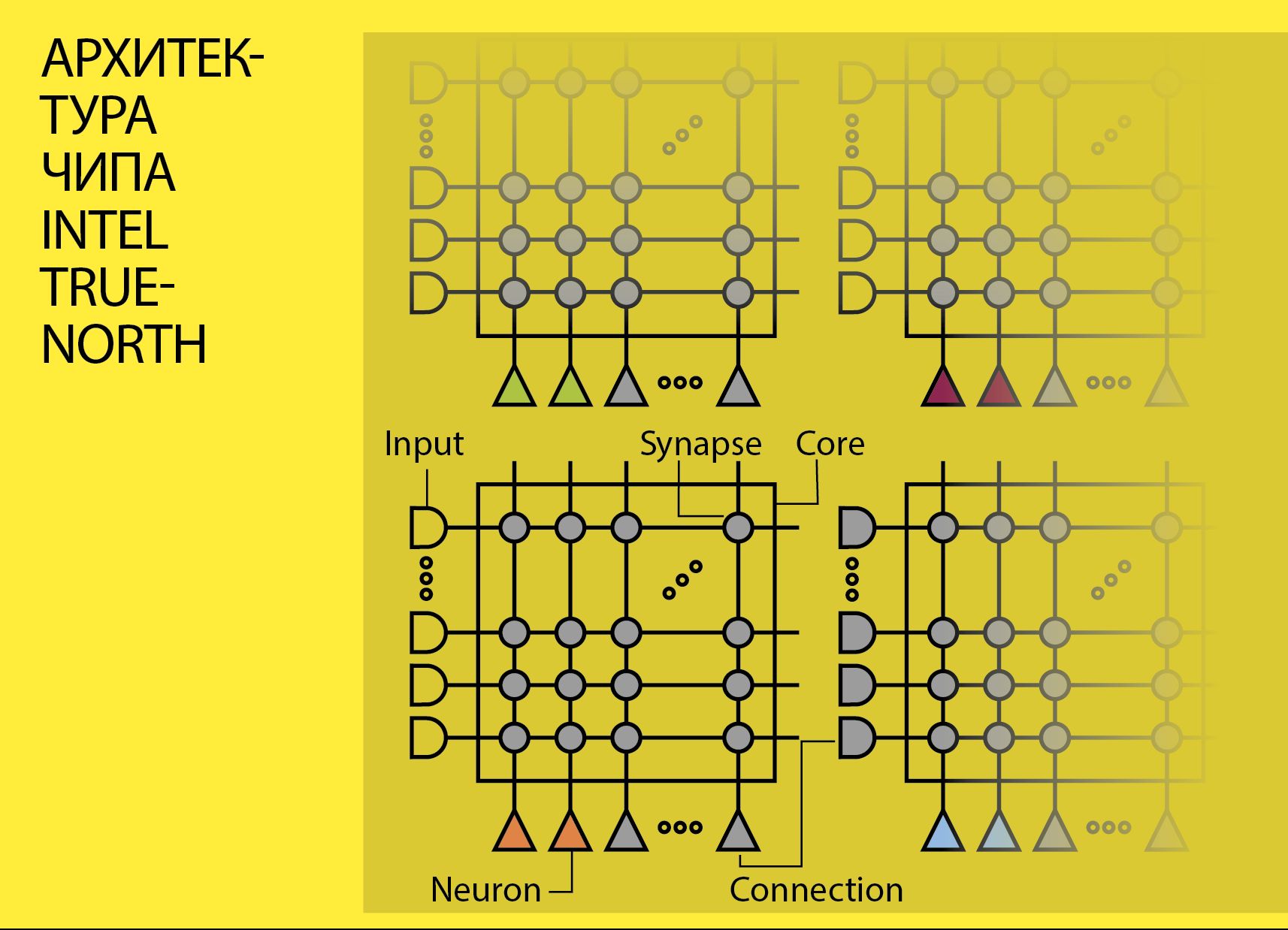

То, как эти идеи воплощаются на практике, можно увидеть на примере нейроморфного чипа TrueNorth от компании IBM. В каждом ядре по горизонтали уложены выходные контакты одного слоя нейронов. По ним проходят импульсы, когда нейрон срабатывает. По вертикали уложены входные контакты следующего слоя нейронов. Они пересекаются в виде квадратной сетки, и каждый узел этой сетки — это синапс между выходным контактом одного нейрона и входным контактом другого. Такая укладка позволяет сделать полносвязную систему, в которой каждый нейрон одного слоя связан с каждым нейроном следующего слоя. Уже в процессе обучения некоторые из этих связей обнуляются, а синапс распадается. По той же схеме подключаются все последующие слои.

Аппаратная система лишена большого энергетического недостатка, присущего программным нейросетям. На классическом компьютере даже если в какой-то части нейросети не проходит никакого сигнала, алгоритм все равно подает эти пустые данные на обсчет. В нейроморфных системах «спящие» нейроны тратят гораздо меньше энергии — только для хранения своего состояния. Более того, сейчас идет активная разработка мемристоров — электронных элементов, которые при подаче тока меняют свое значение и сохраняют его. Если это удастся, они заменят транзисторы, которым для сохранения состояния нужна постоянная подача энергии.

Энергоэффективность открывает нейросетям дорогу к всевозможным мобильным и носимым девайсам. В 2019 году ученые Китая, Сингапура и США представили совместную разработку — гибридный чип Tianjic. В качестве демонстрации возможностей они установили этот чип на велосипед и обучили держать баланс, преодолевать препятствия и выполнять голосовые команды.

В 2020 году на базе нейроморфного чипа Intel Loihi ученые национального университета Сингапура разработали искусственную кожу, которая может распознавать разные формы, текстуры и жесткость предметов на ощупь. Такого рода технологии могут перевернуть рынок бионических протезов.

Еще один плюс — нейроморфные чипы практически неограниченны в возможности масштабирования. В 2019 году Intel представила кластер Pohoiki Beach, соединивший в себе 64 чипа Loihi. А уже через год они же собрали кластер Pohoiki Springs, который соединял в себе 768 чипов Loihi по 128 ядер.

Тем не менее, чтобы догнать масштабы человеческого мозга, потребуется что-то большее, чем линейное наращивание количества кристаллов. В мозге порядка 200 трлн синапсов, что в 2 млн раз больше, чем в самых прогрессивных чипах.

Читайте также о самом распространенном типе чипов:

Использованные источники: Материал опубликован в журнале «Цифровой океан» № 19 (сентябрь-октябрь), 2023, Mina De La O / DigitalVision / Getty Images, Mina De La O / DigitalVision / Getty Images, Andriy Onufriyenko / Moment / Getty Images, dan / Moment / Getty Images, koto_feja / iStock.com, imaginima / iStock.com, Mina De La O / DigitalVision / Getty Images